Si gestionas SEO de un sitio web, Google Search Console (GSC) tiene los datos que más importan: qué consultas traen tráfico, cómo rankea cada página, y dónde están creciendo o cayendo las impresiones. El problema es que la interfaz de GSC limita las tablas a 1.000 filas, anonimiza una porción de las consultas, y solo guarda 16 meses de histórico. Cuando quieres trackear rankings a lo largo del tiempo, construir un dashboard, o cruzar datos de GSC con analítica, necesitas sacar la información de GSC y meterla en algo más flexible.

Google Sheets es el destino más común porque es gratis, scriptable, y conecta directamente con Looker Studio, BigQuery y Power BI sin capa intermedia. Esta guía recorre tres métodos para conectar Search Console a Sheets en 2026, cuándo encaja cada uno, y las limitaciones a tener en cuenta. Cubrimos el mismo workflow para plataformas de paid en nuestra guía de LinkedIn Ads a Google Sheets y guía de TikTok Ads a Google Sheets; este post cierra el círculo del lado orgánico.

Qué expone realmente Search Console (y qué no)

Antes de elegir método, ayuda saber qué datos vas a extraer. La API de Search Console expone las mismas métricas que la UI pero con límites de filas más altos y acceso programático.

Dimensiones disponibles: consulta, página, país, dispositivo, tipo de búsqueda, search appearance (tipos de rich results como FAQ, How-to, Q&A) y fecha.

Valores de tipo de búsqueda: web, imagen, vídeo, news, Discover y Google News (los dos últimos suelen faltar en tutoriales antiguos pero son filtros válidos).

Métricas disponibles: clics, impresiones, CTR y posición media.

Un informe separado de Search Console (Sitemaps) expone un set distinto de métricas (submitted, indexed, warnings, errors) para monitorización de sitemaps. Esta guía se enfoca en Search Analytics, el informe que la mayoría de workflows de reporting consume, pero los mismos métodos de conexión acceden a ambos.

Limitaciones a tener en cuenta:

- La UI limita las tablas a 1.000 filas. La API permite hasta 25.000 filas por request y soporta paginación más allá.

- Los datos históricos están limitados a 16 meses. Los datos más antiguos desaparecen, sin excepciones.

- Una porción de las consultas se anonimiza por privacidad de usuario. La API devuelve totales agregados pero no puede mostrar los términos anonimizados subyacentes. Google no publica el porcentaje exacto; estudios de terceros lo sitúan entre 20% y 60% de las consultas dependiendo de la propiedad, país y periodo.

- Los datos tienen un retraso de 2-3 días. El informe de GSC de hoy muestra datos hasta hace 2-3 días.

- Las cuotas de la API son restrictivas: 1.200 queries por minuto por usuario y 30.000 por día por usuario. Para la mayoría de necesidades de reporting esto sobra; para trackers diarios de rankings sobre miles de páginas, hay que diseñar pensando en eso.

Estas limitaciones no son show-stoppers, pero condicionan qué método tiene sentido según el caso. Un export semanal para refrescar un deck es distinto a un dashboard diario que extrae miles de páginas.

Método 1: Export manual a CSV desde la interfaz de GSC

Mejor para: exports puntuales, propiedades pequeñas, análisis ad-hoc donde no necesitas automatización.

Tiempo de setup: menos de cinco minutos.

Coste: gratis.

Abre Search Console, navega al informe de Performance, configura el rango de fechas y los filtros que necesites, y haz clic en el botón Exportar (arriba a la derecha). Puedes elegir Google Sheets, CSV o Excel como formato de salida. Google Sheets abre una nueva hoja con una pestaña por dimensión (Consultas, Páginas, Países, Dispositivos, Apariencia en Búsqueda, Fechas).

Esto funciona para análisis ad-hoc pero tiene tres limitaciones que lo hacen mal candidato para reporting recurrente. Primero, el export limita cada tabla a 1.000 filas; si tu propiedad tiene más consultas o páginas que eso, solo ves las top 1.000. Segundo, tienes que acordarte de re-exportar cada vez que quieras datos frescos; no hay scheduling. Tercero, no puedes cruzar datos entre dimensiones en una misma tabla (el export deja cada dimensión en su propia pestaña), así que análisis cruzado tipo "consultas por página" requiere stitching manual.

Para un sitio pequeño con menos de 1.000 consultas que de verdad te interesan, el export manual sirve. Para algo más grande o recurrente, pasa a Método 2 o Método 3.

Método 2: Apps Script con la API de Search Console

Mejor para: developers cómodos con JavaScript, reporting de una sola propiedad, control total sobre la forma del request, sin coste recurrente.

Tiempo de setup: 30-60 minutos para la primera integración; 5-10 minutos por cada propiedad adicional.

Coste: gratis (dentro de las cuotas de Apps Script y de la API de GSC).

Apps Script es el camino que toman la mayoría de SEO managers cuando quieren automatizar exports sin pagar por un conector. El setup implica habilitar la API de Search Console, escribir un script que llame a la API, y disparar el script en una agenda.

Paso 1: Habilita la API de Search Console para tu proyecto de Apps Script. Abre script.google.com, crea un nuevo proyecto vinculado a tu Sheet objetivo, ve a Project Settings (icono engranaje) y verifica el proyecto de Google Cloud vinculado. Para uso personal, el proyecto GCP por defecto que crea Apps Script sirve. Después ve a console.cloud.google.com, encuentra ese proyecto, y habilita la API de Google Search Console en APIs y Servicios.

Paso 2: Habilita el Webmasters Advanced Service dentro de Apps Script. En el editor de Apps Script, haz clic en Services (sidebar izquierdo) y añade "Google Search Console API" con la última versión. Esto es lo que permite al script llamar a Webmasters.Searchanalytics.query sin escribir REST manual ni código de OAuth; Apps Script gestiona la autorización automáticamente con la cuenta de Google que ejecuta el script.

Paso 3: Escribe el script de export. Abajo tienes un ejemplo funcional que extrae los últimos 28 días de datos a nivel de consulta a la hoja activa.

function exportSearchConsoleQueries() {

const siteUrl = 'sc-domain:dataslayer.ai'; // o 'https://www.example.com/' para URL prefix

const today = new Date();

const startDate = new Date(today.getTime() - 28 * 24 * 60 * 60 * 1000);

const endDate = new Date(today.getTime() - 3 * 24 * 60 * 60 * 1000); // 3-day delay

const request = {

startDate: Utilities.formatDate(startDate, 'GMT', 'yyyy-MM-dd'),

endDate: Utilities.formatDate(endDate, 'GMT', 'yyyy-MM-dd'),

dimensions: ['query'],

rowLimit: 25000,

startRow: 0

};

const response = Webmasters.Searchanalytics.query(request, siteUrl);

const sheet = SpreadsheetApp.getActiveSpreadsheet().getActiveSheet();

sheet.clear();

sheet.appendRow(['Query', 'Clicks', 'Impressions', 'CTR', 'Position']);

if (response.rows && response.rows.length > 0) {

response.rows.forEach(row => {

sheet.appendRow([

row.keys[0],

row.clicks,

row.impressions,

row.ctr,

row.position

]);

});

}

}

Paso 4: Ejecuta el script por primera vez y autoriza. Haz clic en Run dentro del editor del script. Apps Script te pedirá permiso para acceder a los datos de Search Console a través de tu cuenta. Aprueba.

Paso 5: Programa con un trigger. En Apps Script, abre Triggers (icono reloj, sidebar izquierdo), crea un nuevo trigger, y configúralo para ejecutar exportSearchConsoleQueries con la cadencia que necesites (diaria, semanal, etc.).

Limitaciones de Apps Script:

- Cada ejecución de Apps Script está limitada a 6 minutos en cuentas Workspace gratuitas, 30 minutos en pago. Extraer decenas de miles de filas en un solo script puede chocar con el timeout. Pagina o divide por fecha si tu propiedad es grande.

- La timezone de Apps Script viene en GMT por defecto. Si quieres rangos de fechas en hora local, configura la timezone del proyecto explícitamente en

appsscript.json. - Un fallo a media ejecución deja el Sheet en un estado inconsistente. Añade error handling y escrituras idempotentes si dependes de esto para reporting de producción.

- Cada propiedad requiere un script separado o parametrización. Gestionar 20+ propiedades vía Apps Script se convierte en overhead de mantenimiento.

Para una sola propiedad con necesidades de reporting estables, Método 2 es sólido. Para múltiples propiedades o usuarios que no escriben código, Método 3 es más rápido.

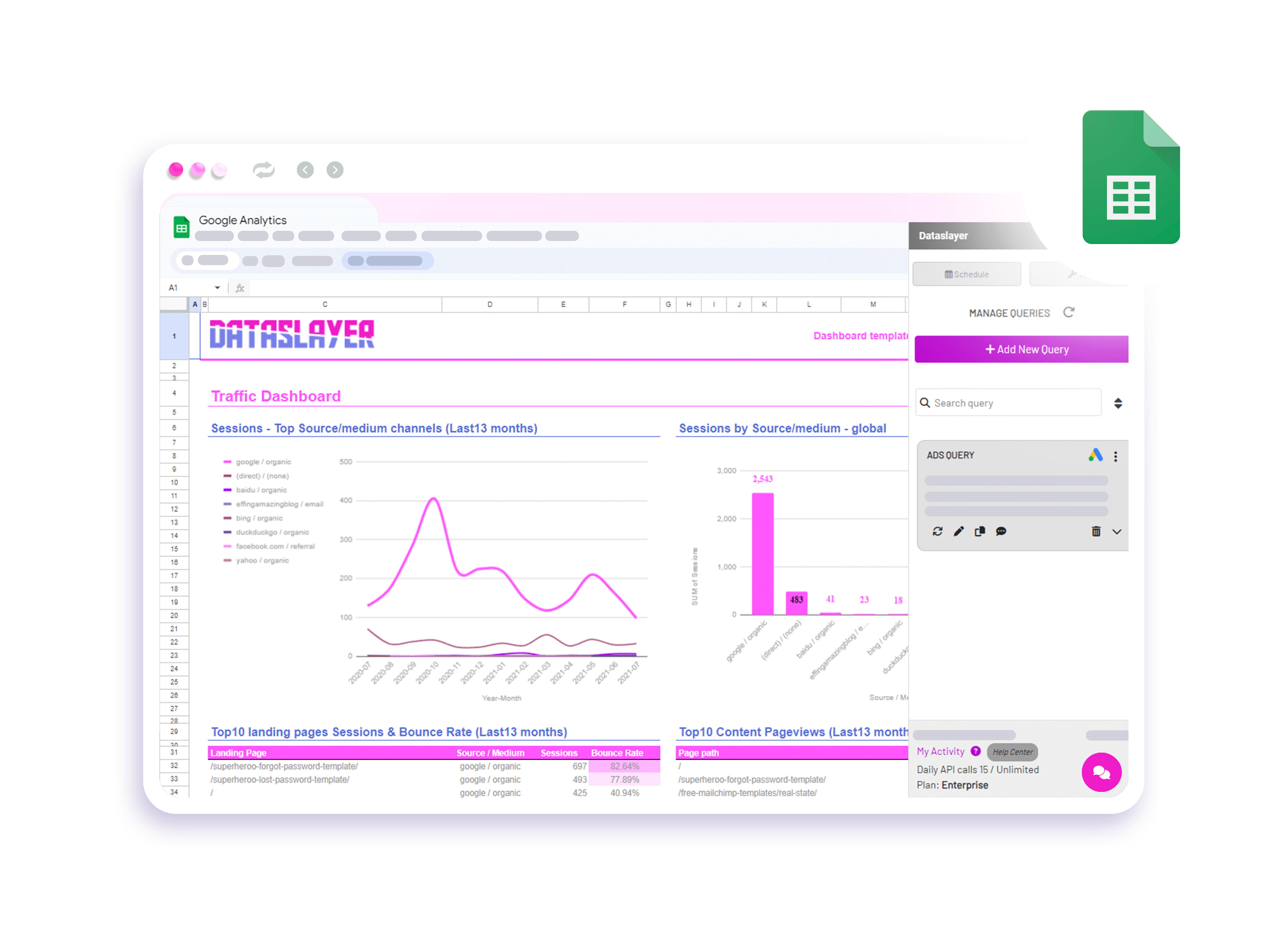

Método 3: Conector programado (no-code)

Mejor para: equipos SEO que gestionan múltiples propiedades, agencias con reporting de clientes, cualquiera que quiera saltarse el mantenimiento de código.

Tiempo de setup: menos de 10 minutos.

Coste: suscripción (Dataslayer empieza en $35/mes en plan anual; prueba gratis disponible).

Los conectores programados gestionan la autenticación con la API, la paginación, el scheduling y la recuperación de errores. Configuras la propiedad, las dimensiones, las métricas y la frecuencia de refresh una vez; el conector mantiene tu Sheet actualizado.

El setup con Dataslayer es directo.

Paso 1: Instala el add-on de Dataslayer. Desde tu Google Sheet, abre Extensiones, luego Complementos, luego Obtener complementos. Busca "Dataslayer" e instala. El add-on solicita los permisos estándar de Google Sheets.

Paso 2: Conecta tu cuenta de Search Console. Abre Extensiones → Dataslayer → Abrir. En el panel, elige Search Console como fuente de datos y haz clic en Conectar. Autoriza con tu cuenta de Google que sea propietaria o tenga acceso a la propiedad de GSC.

Paso 3: Elige la propiedad. Dataslayer lista todas las propiedades de Search Console a las que tu cuenta de Google tiene acceso. Elige la que quieres reportar. Se pueden consultar varias propiedades en una misma hoja usando rangos separados.

Paso 4: Elige dimensiones y métricas. Más allá de las dimensiones nativas de la API, Dataslayer expone dimensiones derivadas que te ahorran tener que escribir lógica custom en fórmulas de Sheets:

- Branded vs. no-branded: defines un regex una vez y Dataslayer marca cada consulta. Útil para separar tráfico de marca de consultas de adquisición en el mismo informe.

- Número de palabras por consulta: agrupa consultas por número de palabras para comparar long-tail vs. términos head.

- Rango de posición: agrupa posiciones en rangos (1-3, 4-10, 11+) en lugar de trabajar con la posición media cruda.

- Niveles de page path (1-4): descompone una URL en niveles jerárquicos para análisis de estructura del sitio sin REGEX en Sheets.

- Country name: nombres de países legibles en lugar de solo códigos ISO.

- Breakdowns temporales nativos: semana, mes, year-week, year-month como dimensiones directas, sin workarounds tipo

=TEXT(date,"yyyy-mm").

Las métricas estándar funcionan como esperas: clics, impresiones, CTR, posición media. Filtros: país, dispositivo, "consulta contiene", "página contiene", etc.

Paso 5: Configura el rango de fechas. Últimos 7 días, últimos 28 días, últimos 90 días, últimos 16 meses, o un rango custom. Para dashboards de tendencia, usa una ventana móvil.

Paso 6: Output de los datos. El conector escribe el resultado en el rango de celdas que selecciones. Desde ahí construye pivot tables, charts, o alimenta Looker Studio desde el mismo Sheet.

Paso 7: Configura el refresh. Diario, semanal o on-demand. El refresh diario es la cadencia más común para dashboards de rankings porque los datos de GSC se actualizan con un retraso de 2-3 días de todas formas.

Limitaciones a saber:

- El conector hereda las cuotas de la API de Search Console. Si consultas la misma propiedad desde múltiples usuarios en el mismo proyecto, comparten el budget diario de 30.000 queries. Para la mayoría de setups de reporting esto es invisible; para agencias grandes, planifica los schedules de refresh.

- Las consultas anonimizadas siguen anonimizadas. Ningún conector puede surfacearlas, porque Google no las devuelve vía API en forma identificable.

- La limitación de 16 meses históricos aplica. Si quieres conservar datos más allá de 16 meses, escribe el output del conector a una tabla de BigQuery o a un Sheet de largo plazo que acumule snapshots mensuales.

Comparando los tres métodos

La decisión normalmente baja a escala y tiempo. Una propiedad y SEO es parte de tu trabajo: Apps Script. Cinco o más propiedades o SEO es tu trabajo a tiempo completo: conector programado. Sitio con menos de 1.000 consultas y reporting solo ad-hoc: export manual.

Casos de uso que merecen ser configurados

Más allá del informe estándar de "consultas y clics", cuatro casos de uso se benefician específicamente de automatizar GSC a Sheets:

Tracking diario de rankings. Extrae la posición media por consulta a cadencia diaria. Construye un gráfico con las top 20 consultas tendiendo a lo largo del tiempo. Detecta caídas de ranking en 2-3 días en lugar de esperar a tu próxima revisión mensual. Si cubres temas afectados por AI Overviews, nuestro análisis sobre cómo AI Overviews están reformulando el CTR explica qué monitorizar en GSC más allá de la posición pura.

Auditorías de CTR a nivel de página. Extrae páginas con muchas impresiones pero CTR bajo (por debajo del 2%, por ejemplo). Estas son las páginas donde el title y la meta description necesitan optimización. Filtra por páginas por encima de un mínimo de impresiones para saltarte el ruido.

Segmentación por país y dispositivo. Extrae las mismas métricas desglosadas por país y dispositivo. Descubre dónde la experiencia móvil está arrastrando conversiones o dónde el tráfico internacional está creciendo sin inversión proporcional.

Joins entre Search Console y GA4. Extrae datos de GSC en una pestaña, datos de landing pages orgánicas de GA4 en otra, y joinea por URL de landing page. Obtén visibilidad de "consultas a conversiones" que ninguna herramienta ofrece sola. El setup es más complejo pero desbloquea atribución que GSC puro no puede mostrar.

Para mejores prácticas de layout de dashboards una vez que los datos están fluyendo, mira nuestra guía de diseño de dashboards. Para agencias que llevan reporting orgánico junto a paid, el post de dashboard multi-channel de atribución muestra cómo unificar GSC, GA4 y plataformas de ads en Looker Studio.

Errores comunes y cómo leerlos

Algunos errores aparecen lo bastante como para que reconocerlos ahorre tiempo.

403 forbidden

429 quota exceeded

400 invalid argument

Respuesta vacía sin error: la propiedad no devolvió datos para el rango de fechas y los filtros. Esto es común para propiedades nuevas (con menos de unas semanas de histórico) o filtros que excluyen todas las filas. Amplía el rango de fechas o quita filtros para verificar.

FAQ

¿Con qué frecuencia actualiza Search Console sus datos?

Search Console actualiza datos a diario pero con un retraso de 2-3 días. El informe de hoy muestra datos hasta hace 2-3 días. Este retraso es el mismo en la UI y en la API; ningún método obtiene datos más frescos que los demás.

¿Puedo exportar datos de Search Console más antiguos de 16 meses?

No. Search Console solo retiene datos durante 16 meses. Los datos más antiguos quedan permanentemente no disponibles. Para preservar histórico más allá de 16 meses, configura exports automáticos a BigQuery o a un Sheet de largo plazo que acumule snapshots mensuales empezando hoy.

¿Por qué mi export de Search Console muestra menos consultas de las que esperaba?

Dos razones. Primero, Google anonimiza una porción de consultas por privacidad de usuario (estimaciones de terceros sitúan esta porción entre 20% y 60% dependiendo de la propiedad, país y periodo); estas se agregan en totales pero los términos subyacentes no se devuelven. Segundo, la UI limita las tablas a 1.000 filas, así que las propiedades grandes chocan con el límite. La API soporta hasta 25.000 filas por request con paginación.

¿Debo usar Domain Property o URL Prefix Property en Search Console?

Las domain properties cubren el dominio entero incluyendo subdominios y protocolos. Las URL prefix properties cubren solo el patrón de URL específico. Para la mayoría de sitios, domain property es la opción más limpia porque consolida todas las variantes. Usa URL prefix solo si necesitas trackear un subdirectorio o subdominio en aislamiento.

¿Cómo gestiona Apps Script las cuotas de la API de Search Console?

Apps Script consume las mismas cuotas diarias y por minuto que cualquier otro cliente de la API. Si tu script hace miles de requests, monitoriza el uso de cuota en Google Cloud Console. Para la mayoría de informes semanales las cuotas son invisibles.

¿Son los datos idénticos entre los tres métodos?

Sí. Los tres métodos llaman al mismo store de datos de Search Console. Las diferencias vienen de los límites de filas (1.000 en UI, 25.000+ vía API) y de la frecuencia de refresh, no de los datos subyacentes. Los valores de clics, impresiones, CTR y posición media son idénticos.

¿Debo exportar datos de Search Console a Sheets o consultarlos directamente en Looker Studio?

Looker Studio tiene un conector nativo de Search Console que no requiere Sheets en el medio. Usa ese camino si tu único destino es un dashboard de Looker Studio. Usa Sheets en el medio cuando necesites manipular los datos (cálculos, joins con otras fuentes) o alimentar múltiples herramientas downstream (Sheets, Looker, Power BI) desde un export limpio.

Conclusión

Los tres métodos para conectar Google Search Console a Google Sheets cubren todo el espectro: CSV manual para exports puntuales, Apps Script para automatización gratis con código, y un conector programado para reporting multi-propiedad sin manos. La elección correcta depende de cuántas propiedades gestionas, si quieres escribir código, y con qué frecuencia los datos necesitan refrescarse.

La API de Search Console tiene limitaciones reales (límite de 1.000 filas en UI, 16 meses de histórico, consultas anonimizadas, retraso de 2-3 días) pero con el método correcto puedes construir dashboards SEO que se actualizan a diario sin trabajo manual. Si quieres saltarte la configuración de Apps Script y conectar Search Console a Google Sheets, Looker Studio, BigQuery o Power BI en menos de 10 minutos, empieza una prueba gratis de Dataslayer.

.avif)